Physical Address

304 North Cardinal St.

Dorchester Center, MA 02124

Physical Address

304 North Cardinal St.

Dorchester Center, MA 02124

Künstliche Intelligenz (KI) produziert hyperrealistische “digitale Zwillinge” von Politikern, Prominenten, pornografischem Material und mehr – Opfer von Opfern von DeepFake -Technologie Schwierigkeiten, den rechtlichen Rückgriff zu bestimmen.

Der ehemalige CIA -Agent und Cybersicherheitsexperte Dr. Eric Cole erzählte Fox News Digital Diese schlechten Online -Datenschutzpraktiken und die Bereitschaft der Menschen, ihre Informationen in sozialen Medien öffentlich zu veröffentlichen, lässt sie für KI -Deepfakes anfällig.

“Die Katze ist schon aus der Tasche”, sagte er.

“Sie haben unsere Bilder, sie kennen unsere Kinder, sie kennen unsere Familie. Sie wissen, wo wir leben. Und jetzt in der Lage, alle Daten darüber zu nehmen, wer wir sind, wie wir aussehen, was wir tun und wie wir uns handeln, und im Grunde genommen in der Lage sein, einen digitalen Zwilling zu erstellen”, fuhr Cole fort.

Beachten Sie diese Tipps, um zu vermeiden, dass sie von A-generierten Deepfakes betrogen werden

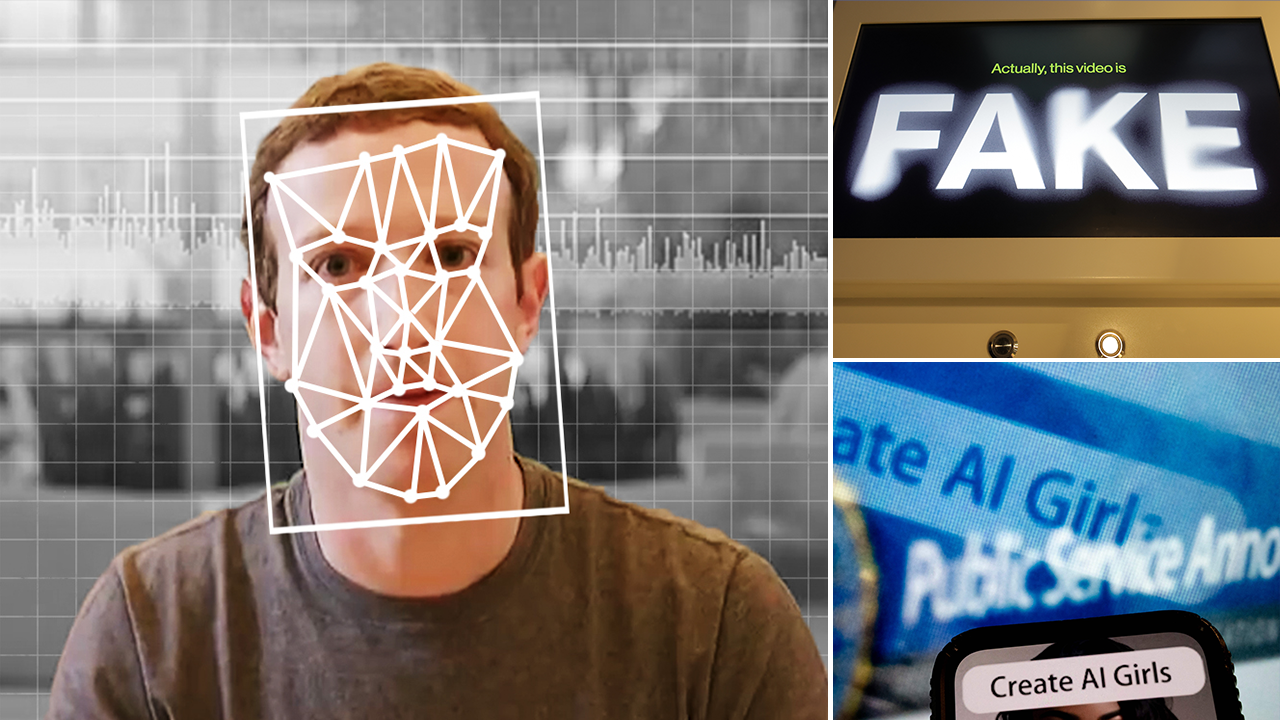

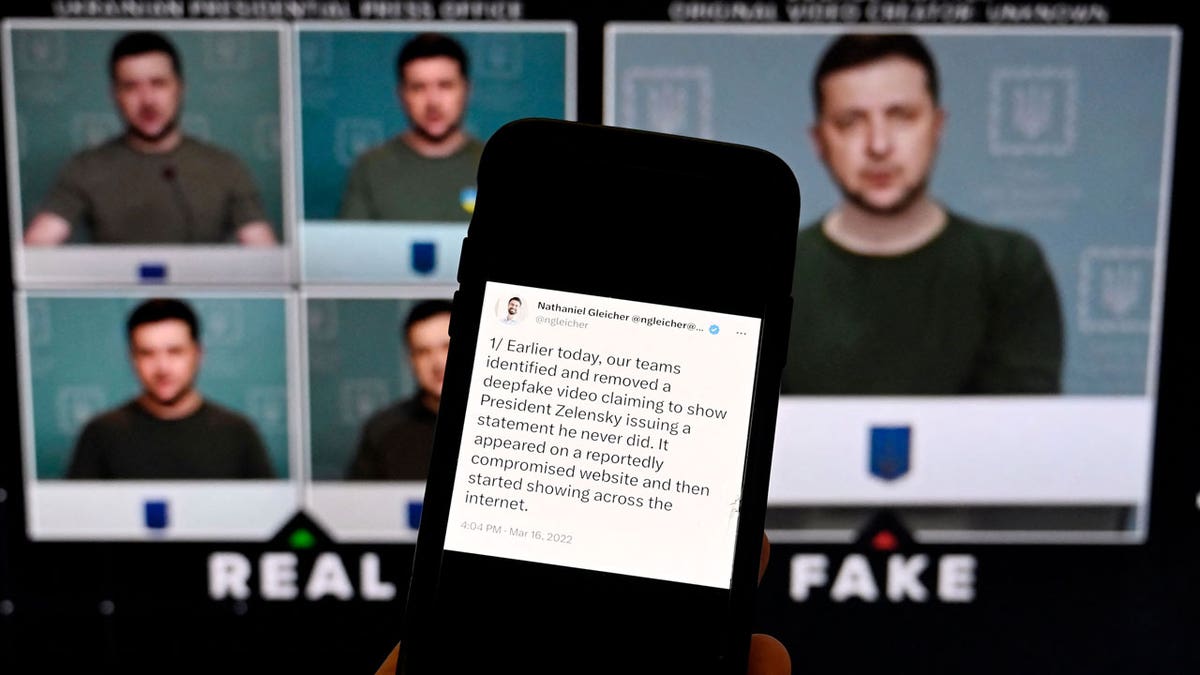

AI-generierte Bilder, die als “DeepFakes” bezeichnet werden, beinhalten oft die Bearbeitung von Videos oder Fotos von Menschen, damit sie wie jemand anderes aussehen oder ihre Stimme verwenden, um Aussagen zu machen, die sie in der Realität nie ausgesprochen haben. (Elyse Samuels/The Washington Post/Lane Turner/The Boston Globe/Stefani Reynolds/AFP über Getty Images))

Dieser digitale Zwilling, so behauptete er, sei so gut, dass es schwierig ist, den Unterschied zwischen der künstlichen Version und der realen Person zu erkennen, auf der die Deepfake basiert.

Im vergangenen Monat zirkulierte ein betrügerischer Audioclip von Donald Trump Jr., dass die USA militärische Ausrüstung anstelle der Ukraine nach Russland schicken sollen.

Der Beitrag wurde in den sozialen Medien weithin diskutiert und schien ein Clip aus einer Episode des Podcasts “ausgelöst mit Donald Trump Jr.” zu sein

Experten in der digitalen Analyse bestätigten später, dass die Aufzeichnung von Trump Jr.s Stimme mit AI erstellt wurde, und stellte fest, dass die Technologie “kompetenter und anspruchsvoller” geworden ist.

FactPostnews, an offizieller Bericht der Demokratischen Partei, postete das Audio, als wäre es authentisch. Das Konto löschte später die Aufzeichnung. Ein anderer Bericht, Republikaner gegen Trump, haben den Clip ebenfalls gepostet.

In den letzten Jahren wurden zahlreiche Beispiele für AI -Deepfakes verwendet, um die Zuschauer irreführend mit politischen Inhalten zu führen. Ein Video von 2022 zeigte, was schien zu sein Ukrainischer Präsident Volodymyr Zelenskyyy Die Übergabe an Russland – aber der gefälschte Clip wurde schlecht gemacht und nur kurz online verbreitet.

Manipulierte Videos von Präsident Donald Trump und ehemaliger Präsident Joe Biden Später erschien im Vorfeld der US-Präsidentschaftswahlen 2024. Basierend auf vorhandenen Videos veränderten diese Clips häufig die Worte oder Verhaltensweisen von Trump und Biden.

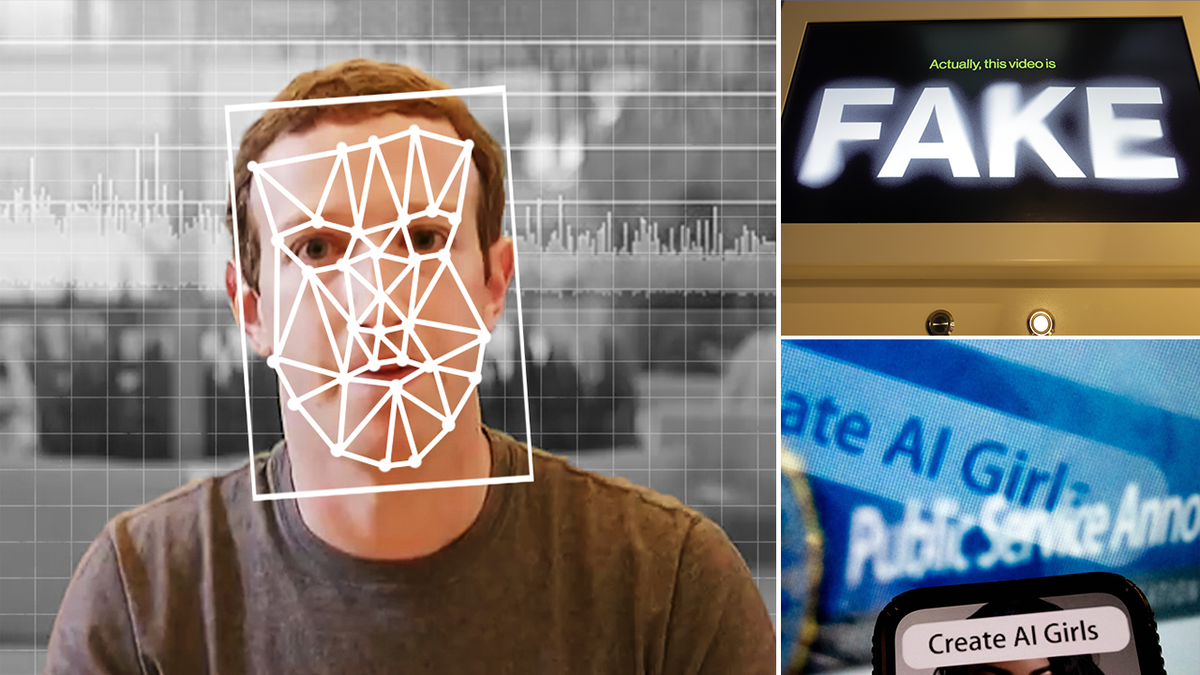

Eine Frau in Washington, DC, sieht am 24. Januar 2019 ein manipuliertes Video an, das die von Präsident Donald Trump und ehemaligen Präsident Barack Obama gesagt wird und veranschaulicht, wie sich die DeepFake -Technologie entwickelt hat. (Rob Hebel /AFP über Getty Images)

AI-generierte Bilder, die als “DeepFakes” bezeichnet werden, beinhalten oft die Bearbeitung von Videos oder Fotos von Menschen, damit sie mit KI wie jemand anderes aussehen lassen. DeepFakes erreichte 2017 das Radar der Öffentlichkeit, nachdem ein Reddit-Benutzer realistisch aussehende Pornografie von Prominenten auf der Plattform gepostet hatte und die Schleusen für Benutzer geöffnet hatte, die KI einsetzen, damit Bilder überzeugender aussehen und dazu führen, dass sie in den folgenden Jahren weiter geteilt werden.

Cole sagte gegenüber Fox News Digital, dass die Menschen in Bezug auf KI -Deepfakes ihr “eigener schlimmster Feind” sind, und die Begrenzung der Online -Exposition kann der beste Weg sein, um nicht zum Opfer zu werden.

In Politik und Medien, in denen “Sichtbarkeit von entscheidender Bedeutung ist”, ist es jedoch in der Politik und in den Medien “,” die Sichtbarkeit “, in der Tatsache öffentliche Persönlichkeiten Werden Sie ein Hauptziel für den schändlichen KI -Gebrauch. Ein Bedrohungsakteur, der daran interessiert ist, Präsident Trump zu replizieren, wird viel Futter haben, um einen digitalen Zwilling zu erstellen, der Daten des US -Leiters in verschiedenen Umgebungen abnimmt.

Der Kongress muss ein neues KI -Tool stoppen, das verwendet wird, um Kinder auszunutzen

“Je mehr Video ich machen kann, wie er geht, wie er spricht, wie er sich verhält, ich kann das in das KI -Modell einfügen und ich kann Deepfake machen, das so realistisch ist wie Präsident Trump. Und hier werden die Dinge wirklich, wirklich beängstigend”, fügte Cole hinzu.

Cole übernimmt nicht nur die persönliche Verantwortung, personenbezogene Daten online zu vierteln, sondern auch eine weitere Methode, um die unsachgemäße Verwendung von KI einzudämmen.

Sens. Ted Cruz, R-Texas und Amy Klobuchar, D-Minn. Nimm es down act, Dies würde es zu einem Bundesverbrechen machen, nicht einvernehmliche intime Bilder zu veröffentlichen oder mit der Veröffentlichung von “digitalen Fälschungen” zu veröffentlichen, einschließlich künstlicher Intelligenz. Der Gesetzentwurf hat den Senat Anfang 2025 einstimmig verabschiedet. Cruz sagte Anfang März, er glaubt, dass er vom Haus verabschiedet wird, bevor er Gesetz wird.

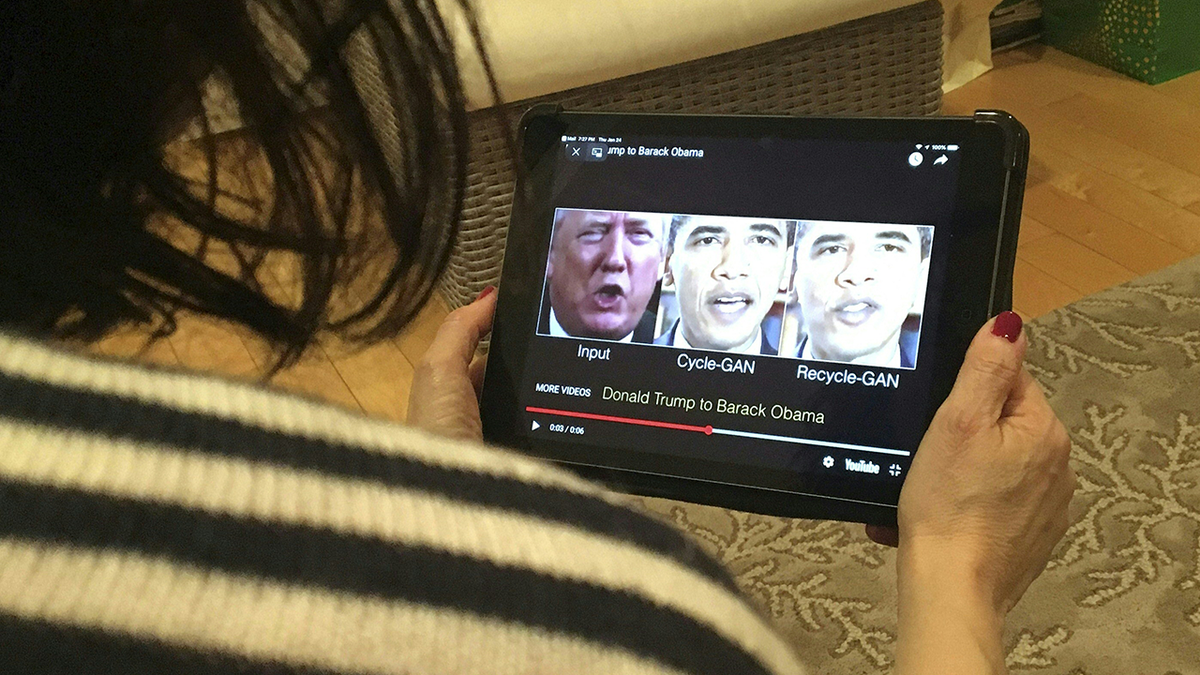

First Lady Melania Trump reiste am Montag nach Capitol Hill, um einen Rundtisch für die Take It Down -Act zu sammeln. (Fox News)

Die vorgeschlagene Gesetzgebung würde eine Strafen von bis zu drei Jahren Gefängnis erfordern, um nicht einvernehmliche intime Bilder-authentisch oder AI-generiert-mit Minderjährigen und zwei Jahren Gefängnis für die Bilder mit Erwachsenen zu teilen. Es würde auch Strafen von bis zu zweieinhalb Jahren Gefängnisstrafe für Bedrohungsdelikte mit Minderjährigen und eineinhalb Jahren Gefängnis für Bedrohungen mit Erwachsenen erfordern.

Die Gesetzesvorlage würde auch Social -Media -Unternehmen wie Snapchat, Tiktok, Instagram und ähnliche Plattformen erfordern, um Verfahren einzurichten, um diese Inhalte innerhalb von 48 Stunden nach der Kündigung des Opfers zu entfernen.

Schüler, die Eltern, warnten die Eltern vor DeepFake -Nacktfoto -Bedrohung

First Lady Melania Trump sprach Anfang dieses Monats zum ersten Mal seit seiner Rückkehr zum Weißen Haus auf dem Capitol Hill, nahm an einem Roundtable mit dem Gesetzgeber teil und teilte sie Opfer von Rachepornos und Ai-generierte Deepfakes.

“Ich bin heute mit einem gemeinsamen Ziel hier bei Ihnen – um unsere Jugend vor Online -Schaden zu schützen”, sagte Melania Trump am 3. März.

Andy Locascio, Mitbegründer und Architekt von Eternos.life (der der Erstellung des ersten digitalen Zwillings zugeschrieben wurde), sagte, dass es zwar unrealistisch ist, während die “Take It Down” -Tat ein “Kinderspiel” sei, aber es ist wirksam anzunehmen, dass es wirksam sein wird. Er merkt an, dass ein Großteil der KI -Deepfake -Branche von Standorten, die nicht dem US -amerikanischen Recht unterliegen, zu bedienen wird, und die Gesetzgebung würde wahrscheinlich nur einen winzigen Bruchteil der beleidigenden Websites beeinflussen.

Der nationale Sicherheitsexperte Paul Scharre sieht ein manipuliertes Video von BuzzFeed mit dem Filmemacher Jordan Peele (R auf dem Bildschirm) an, das leicht verfügbare Software und Anwendungen verwendet, um das zu ändern, was von dem ehemaligen Präsidenten Barack Obama (L auf dem Bildschirm) gesagt wird, und veranschaulicht, wie DeepFake -Technologie die Zuschauer in seinen Offices in Washington, DC, am 25. Januar 2019 täuschen kann. (Rob Hebel/AFP über Getty Images)

Er bemerkte auch, dass die Klonierung von Text-to-Speech-Technologie jetzt “perfekte Fälschungen” schaffen kann. Während die meisten wichtigen Anbieter erhebliche Kontrollen haben, um die Schaffung von Fälschungen zu verhindern, sagte Locascio gegenüber Fox News Digital, dass einige kommerzielle Anbieter leicht täuschen seien.

Darüber hinaus sagte Locascio, dass jeder, der Zugriff auf eine einigermaßen leistungsstarke grafische Prozessoreinheit (GPU) hat, seine eigenen Sprachmodelle erstellen könnte, die “Klone” unterstützen können. Einige verfügbare Dienstleistungen erfordern weniger als 60 Sekunden Audio, um dies zu produzieren. Dieser Clip kann dann mit Basic -Software bearbeitet werden, um ihn noch überzeugender zu machen.

“Das Paradigma bezüglich des Realismus von Audio und Videos hat sich verschoben. Jetzt muss jeder annehmen, dass das, was er sieht und hört, falsch ist, bis sie sich als authentisch erwiesen”, sagte er gegenüber Fox News Digital.

Während es kaum strafrechtliche Anleitungen in Bezug auf KI -Deepfakes gibt, sagt Anwalt Danny Karon, dass mutmaßliche Opfer immer noch zivile Ansprüche eingehen und Geldschäden erhalten können.

In seinem bevorstehenden Buch “Your Lovable Lawyer’s Guide to Legal Wellness: Back gegen eine Welt, die Sie betrügen will” stellt Karon fest, dass AI -Deepfakes unter das traditionelle Verleumdungsgesetz fallen, insbesondere Verleumdung, die eine falsche Aussage über Literatur (Schreiben, Bilder, Audio und Video) verbreitet.

Dieses Illustrationsfoto, das am 30. Januar 2023 aufgenommen wurde (Olivier Doulliery/AFP über Getty Images)

Um eine Verleumdung zu beweisen, muss ein Kläger Beweise und Argumente zu bestimmten Elementen vorlegen, die der rechtlichen Definition der Verleumdung nach dem staatlichen Recht entsprechen. Viele Staaten haben ähnliche Standards für das Nachweis der Verleumdung.

Zum Beispiel nach Virginia Law, wie es in der der Fall war Depp v. Hörte Gerichtsverhandlung, Das Team von Schauspieler Johnny Depp musste die folgenden Elemente erfüllen, die eine Verleumdung darstellen:

“Sie können nicht schließen, dass etwas Verleumdung ist, bis Sie wissen, was das Gesetz und die Verleumdung sind. Amber hörte zum Beispiel nicht, weshalb sie nicht glaubte, dass sie etwas falsch gemacht hat.

Karon teilte Fox News Digital mit, dass AI DeepFake -Behauptungen auch durch Invasion des Datenschutzgesetzes, des Übertretungsgesetzes, des zivilen Stalkings und des Rechts auf Werbung kanalisiert werden können.

Bundesrichter blockiert das kalifornische Recht, die Wahl DeepFakes verbieten

Das hyperrealistische Bild von Bruce Willis ist tatsächlich eine Deepfake, die von einem russischen Unternehmen erstellt wurde, das künstliche neuronale Netze nutzt. (Deepcake über Reuters)

“Wenn Tom Hanks seine Stimme kürzlich kooptiert hat, um einen Zahnarztplan zu fördern, ist dies ein Beispiel für ein Unternehmen, das den Namen, das Bild und die Ähnlichkeit von jemandem ausnutzt, und in diesem Fall die Stimme, um ein Produkt zu verkaufen, Werbung von jemand anderem zu fördern oder um Werbung von jemand anderem abzuleiten. Das können Sie nicht”, sagte er.

Leider können Probleme auftreten, wenn ein Kläger nicht feststellen kann, wer die DeepFake erstellt hat oder ob sich der Täter in einem anderen Land befindet. In diesem Zusammenhang muss jemand, der einen Verleumdungsfall verfolgen möchte, möglicherweise einen Webexperten einstellen, um die Quelle des Inhalts zu finden.

Wenn die Person oder das Unternehmen international ist, wird dies zu einem Veranstaltungsort. Selbst wenn eine Person gefunden wird, muss ein Kläger die Antwort auf diese Fragen bestimmen:

Wenn die Antwort auf einige dieser Fragen Nein lautet, ist es möglicherweise nicht wert, die Zeit und die Finanzen zu investieren, die zur Verfolgung dieser Behauptung erforderlich sind.

“Unsere Rechte sind nur so effektiv wie unsere Fähigkeit, sie durchzusetzen, wie ein Patent. Die Leute sagen: ‘Ich habe ein Patent, also bin ich geschützt.’ Nein, ein Patent ist nur so lohnend, wie Sie es durchsetzen können.

Klicken Sie hier, um die Fox News -App zu erhalten

Brooke Singman und Emma Colton von Fox News haben zu diesem Bericht beigetragen.